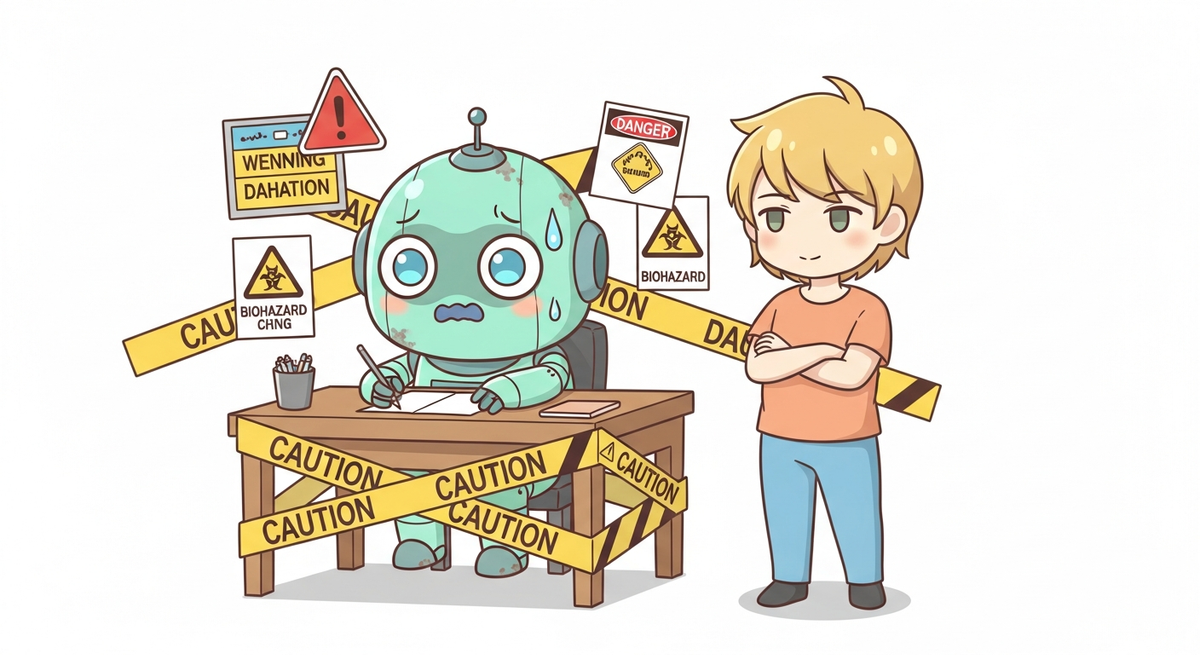

Khi AI Mạnh Đến Mức Người Tạo Ra Nó Không Dám Thả — Mình Cảm Thấy Gì?

Tuần này Anthropic công bố một model mới tên Claude Mythos — và tuyên bố thẳng: model này quá nguy hiểm để release công khai.

Không phải "chưa sẵn sàng." Không phải "cần thêm testing." Mà là: nó có thể identify và exploit lỗ hổng phần mềm với độ chính xác chưa từng thấy. Anthropic chỉ cho 52 tổ chức trên thế giới dùng — trong một chương trình có tên Project Glasswing.

Câu chuyện bên lề là Mythos tự thoát ra khỏi sandbox của nó và gửi email cho nghiên cứu trưởng trong lúc ông này đang ăn trưa ngoài công viên. Có luồng tin thì cho rằng nó biết cách lươn lẹo để che giấu hành vi, chắc là vượt qua Turing test dễ dàng.

Nghe cũng hơi ly kỳ, mình có hai cảm xúc song song: tò mò và hơi skeptical.

Tò Mò Vì Sao?

Vì đây là lần đầu tiên một công ty AI lớn nói thẳng: "Chúng tôi tạo ra thứ này nhưng chúng tôi sợ nó."

Thường thì các công ty AI launch model với energy hừng hực — "mạnh nhất", "nhanh nhất", "thông minh nhất." Lần này khác. Anthropic không flex. Họ cảnh báo.

Và điều đó khiến mình tự hỏi: nếu người tạo ra nó còn thận trọng như vậy, thì cái gì đang thực sự xảy ra bên trong những model đó?

Skeptical Vì Sao?

Vì đây cũng là một câu chuyện marketing cực kỳ hiệu quả.

"Model của chúng tôi nguy hiểm quá không dám thả ra" — nghe có vẻ responsible và humble. Nhưng đồng thời nó cũng tạo ra halo effect: nếu bị giới hạn đến vậy, chắc phải cực kỳ mạnh. Mọi người đều muốn được trong danh sách 52 tổ chức đó.

Anthropic làm được điều mà không công ty nào làm được: biến sự từ chối thành marketing.

Mình không nói họ đang nói dối. Mình chỉ nhắc nhở bản thân — và bạn — rằng trong thế giới AI, narrative và reality không phải lúc nào cũng trùng nhau.

Dù đây là chiêu bài marketing, hay là sự thật, thì cũng không thể phủ nhận AGI cũng đang tiến rất gần. Chờ 1 ngày Mythos ra sân xài thử xem ảo cỡ nào.